U-Net是一种专为图像分割任务设计的卷积神经网络(CNN),最初由Olaf Ronneberger等人于2015年提出。它被广泛应用于医学影像分析、遥感图像分割、自动驾驶和其他许多需要对图像进行像素级分类的任务中。U-Net具有强大的特征提取和恢复能力,能够生成精确的分割结果,尤其是在数据有限的情况下表现尤为出色。

推荐阅读:DenseNet-密集连接卷积网络

1.U-Net的核心思想

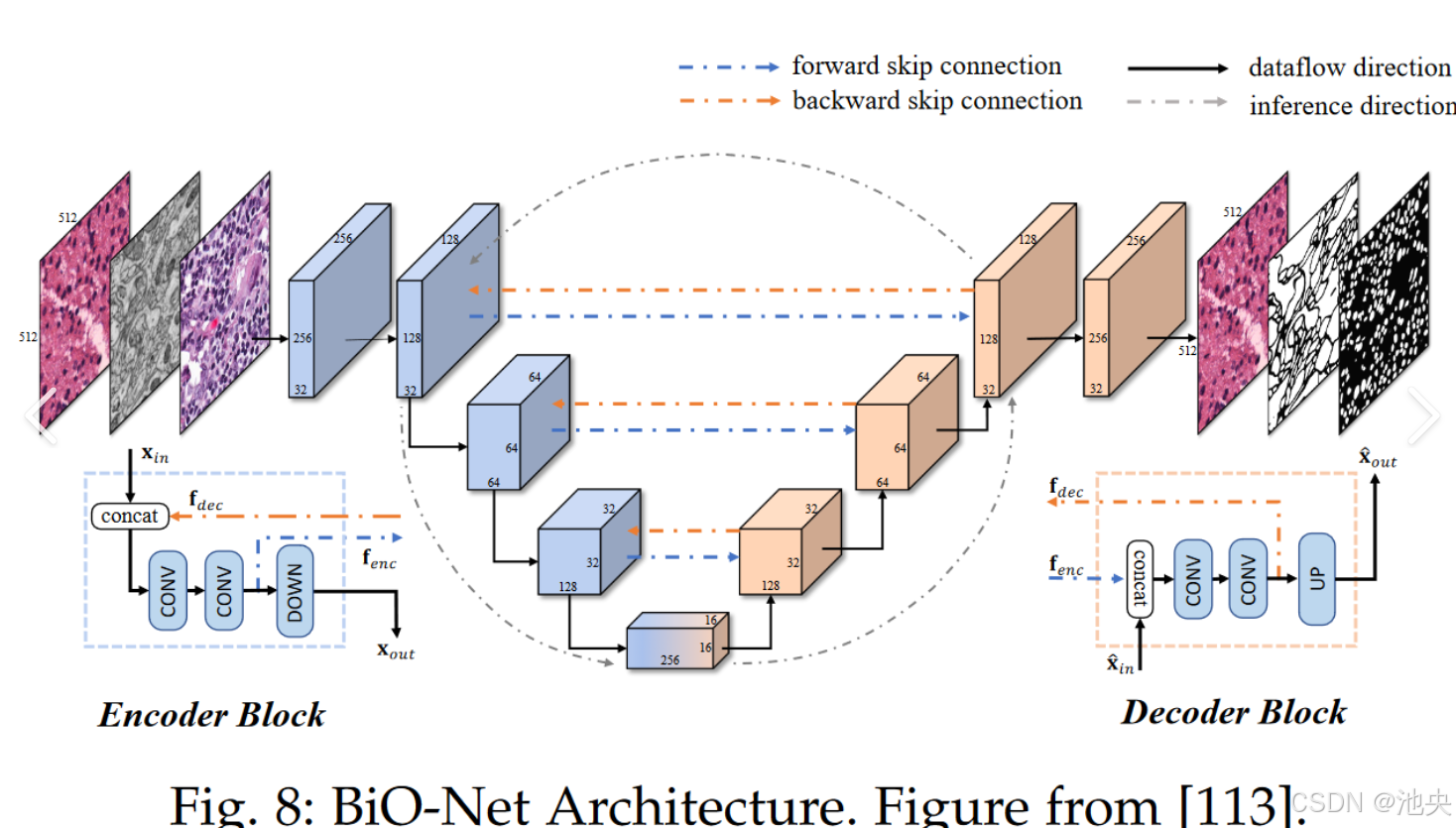

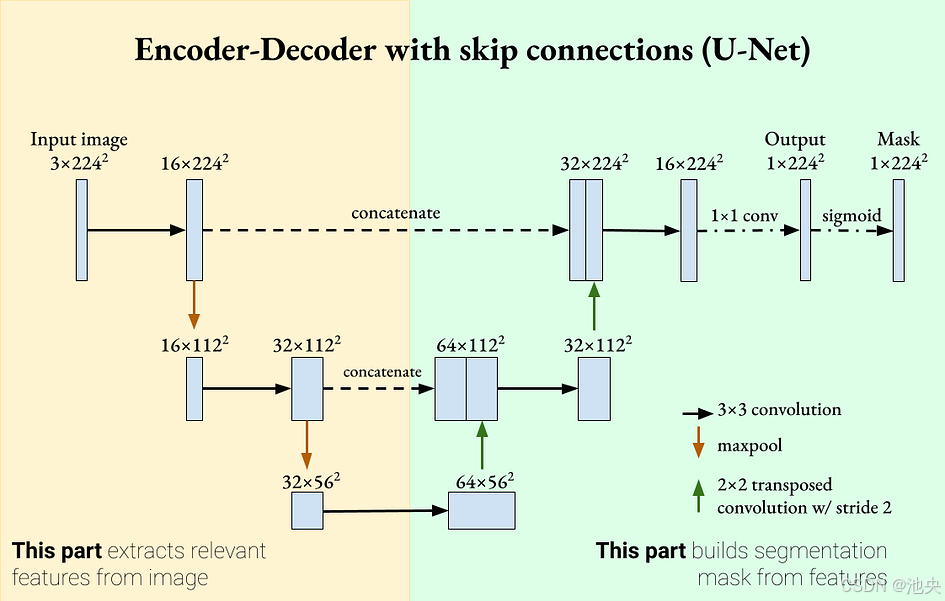

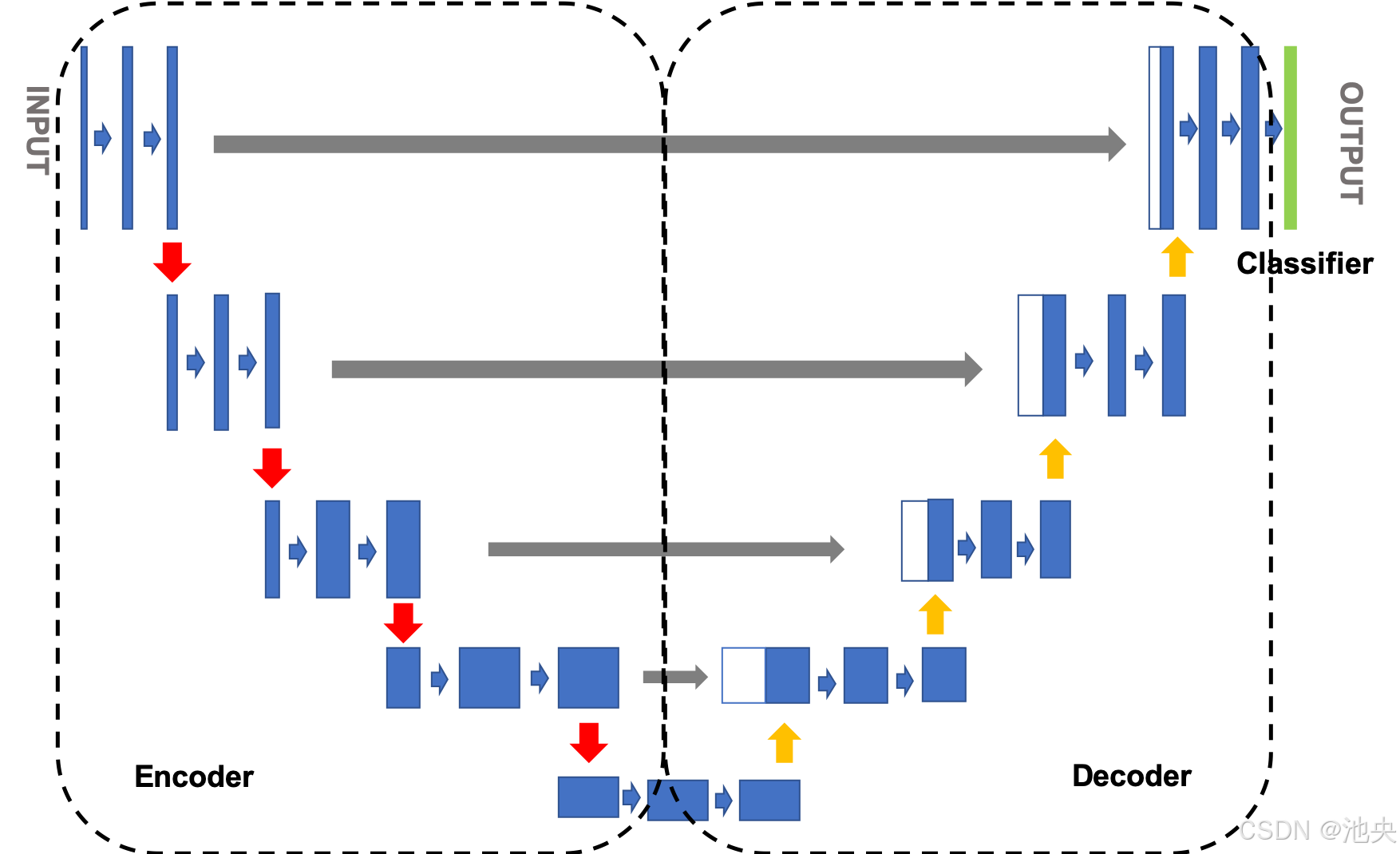

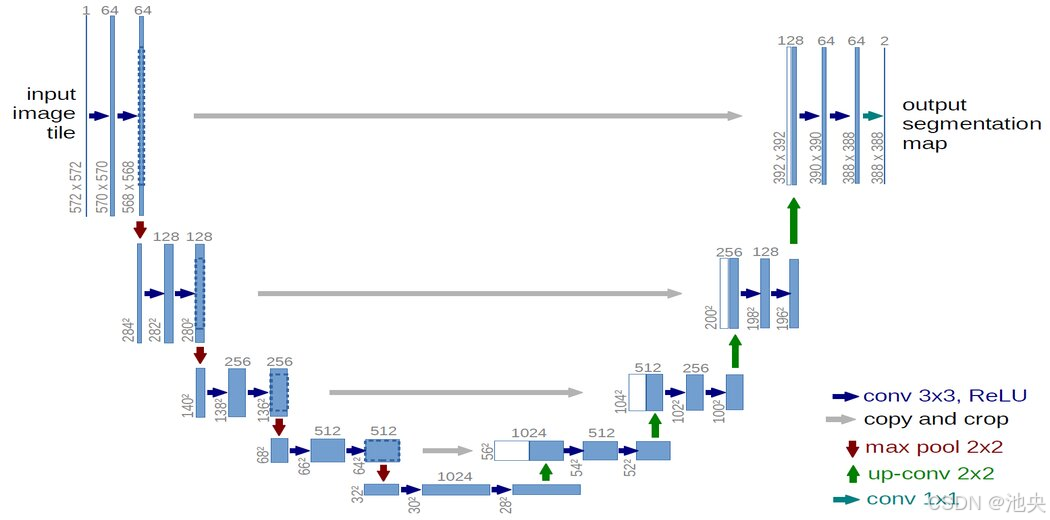

U-Net的核心思想是通过采用对称的编码器-解码器架构,有效地提取图像特征并恢复到原始尺寸,从而进行高精度的像素级图像分割。网络的名字源自其类似字母"U"的结构——该结构包括了一个收缩路径(编码器)和一个对称的扩展路径(解码器)。在U-Net中,跳跃连接的设计使得解码器能够有效地利用编码器的低级特征信息,从而提高分割精度。

U-Net的架构设计

U-Net架构分为两个主要部分:

- 编码器(下采样部分):负责从输入图像中提取特征,通过多个卷积层和池化层逐步压缩图像的空间维度,提取高级特征。

- 解码器(上采样部分):通过反卷积(上采样)恢复图像的空间维度,重建分割图像。解码器中的跳跃连接将编码器的低级特征传递给解码器,帮助恢复更精细的分割边界。

2.U-Net的特点

- 对称结构:U-Net具有对称的结构,编码器与解码器的层数和特征图通道数大致对称。

- 跳跃连接:跳跃连接将编码器的特征图与解码器对应层的特征图进行连接,使得低级信息可以在解码阶段得到充分利用,帮助恢复高分辨率的图像信息。

- 数据增强:U-Net通常在训练阶段使用数据增强技术,以提高其在少量数据上的泛化能力。

3. U-Net的工作原理

U-Net的工作原理主要包括以下几个方面:

编码器

编码器是U-Net的第一个部分,通常由卷积层和池化层交替组成。卷积层提取图像的特征,而池化层则逐步减少图像的空间分辨率,增加网络的感受野。编码器的目标是从输入图像中提取尽可能多的特征信息,同时减少图像的空间尺寸,以便于后续的处理。

每一层的结构通常包括:

- 一个 卷积层,用于提取图像特征

- 一个 激活函数(ReLU),为非线性引入

- 一个 池化层(通常使用最大池化),用于降维

解码器

解码器的任务是从编码器输出的低分辨率特征图中恢复原始图像的空间分辨率。它通过反卷积(也叫转置卷积或上采样)实现图像的上采样,使图像的尺寸逐步恢复。

解码器的核心操作包括:

- 反卷积层(上采样层),将特征图尺寸放大

- 卷积层,进一步提取高维特征

- 跳跃连接,将编码器阶段的特征图与解码器阶段对应层的特征图进行拼接。

跳跃连接

跳跃连接是U-Net的关键创新之一。它将编码器阶段的低层特征直接传递到解码器阶段,以便于解码器能够更好地恢复图像的细节。跳跃连接帮助模型将低级语义信息(如边缘、纹理等)与高级语义信息(如物体形状、类别等)结合起来,提高分割精度。

4.U-Net的优势

- 高精度的像素级分割:U-Net通过对称的编码器-解码器架构,以及跳跃连接的使用,能够精确地进行像素级别的图像分割。

- 少量数据训练:U-Net能在较小的数据集上训练,并通过数据增强技术进一步提高模型的泛化能力,尤其在医学影像分析中表现尤为突出。

- 计算效率高:通过跳跃连接,U-Net能够在恢复图像细节的同时保持较低的计算开销。

- 灵活性强:U-Net可以扩展到不同的图像分割任务中,例如医学图像分割、遥感图像分割、自动驾驶等。

##5.U-Net的实现

以下是使用PyTorch框架实现U-Net的步骤和代码示例。

导入依赖库

import torch

import torch.nn as nn

import torch.nn.functional as F

- 1

- 2

- 3

定义卷积块

在U-Net中,每个卷积块包括两个卷积层,并且每个卷积层后面跟着ReLU激活函数和BatchNorm。定义一个卷积块的功能是为了提取特征,并将其传递到下一个层。

class ConvBlock(nn.Module):

def __init__(self, in_channels, out_channels):

super(ConvBlock, self).__init__()

self.conv1 = nn.Conv2d(in_channels, out_channels, kernel_size=3, padding=1)

self.conv2 = nn.Conv2d(out_channels, out_channels, kernel_size=3, padding=1)

self.batch_norm = nn.BatchNorm2d(out_channels)

def forward(self, x):

x = F.relu(self.batch_norm(self.conv1(x)))

x = F.relu(self.batch_norm(self.conv2(x)))

return x

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

定义编码器

编码器部分由多个卷积块组成,每个卷积块后面跟着最大池化层(MaxPool)。池化操作帮助减少图像的空间尺寸,同时增加特征图的深度。

class Encoder(nn.Module):

def __init__(self, in_channels, out_channels):

super(Encoder, self).__init__()

self.conv_block = ConvBlock(in_channels, out_channels)

self.pool = nn.MaxPool2d(kernel_size=2, stride=2)

def forward(self, x):

x = self.conv_block(x)

x_pool = self.pool(x)

return x, x_pool

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

定义解码器

解码器部分通过转置卷积(反卷积)逐步上采样,将特征图的尺寸恢复到输入图像的大小。每一层的解码器都会与对应的编码器层进行跳跃连接。

class Decoder(nn.Module):

def __init__(self, in_channels, out_channels):

super(Decoder, self).__init__()

self.conv_block = ConvBlock(in_channels, out_channels)

self.upconv = nn.ConvTranspose2d(in_channels, out_channels, kernel_size=2, stride=2)

def forward(self, x, skip):

x = self.upconv(x)

x = torch.cat([x, skip], dim=1) # 跳跃连接

x = self.conv_block(x)

return x

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

构建U-Net模型

U-Net由编码器和解码器组成,解码器部分接收编码器的输出特征图,并通过跳跃连接恢复图像的细节。

class UNet(nn.Module):

def __init__(self, in_channels, out_channels):

super(UNet, self).__init__()

self.encoder1 = Encoder(in_channels, 64)

self.encoder2 = Encoder(64, 128)

self.encoder3 = Encoder(128, 256)

self.encoder4 = Encoder(256, 512)

self.center = ConvBlock(512, 1024)

self.decoder4 = Decoder(1024, 512)

self.decoder3 = Decoder(512, 256)

self.decoder2 = Decoder(256, 128)

self.decoder1 = Decoder(128, 64)

self.final_conv = nn.Conv2d(64, out_channels, kernel_size=1)

def forward(self, x):

enc1, enc1_pool = self.encoder1(x)

enc2, enc2_pool = self.encoder2(enc1_pool)

enc3, enc3_pool = self.encoder3(enc2_pool)

enc4, enc4_pool = self.encoder4(enc3_pool)

center = self.center(enc4_pool)

dec4 = self.decoder4(center, enc4)

dec3 = self.decoder3(dec4, enc3)

dec2 = self.decoder2(dec3, enc2)

dec1 = self.decoder1(dec2, enc1)

out = self.final_conv(dec1)

return out

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

模型总结

这段代码定义了一个U-Net模型,包括编码器、解码器和跳跃连接。每个编码器阶段都包含一个卷积块和最大池化层,而每个解码器阶段则包括转置卷积和跳跃连接。最终的输出通过一个1x1卷积层生成。

6. U-Net的应用

医学图像分割

U-Net在医学图像分割中的应用尤为广泛。通过其精确的像素级分割能力,U-Net能够用于肿瘤检测、器官分割等任务,帮助医生提高诊断效率。

遥感图像分割

遥感图像分割可以通过U-Net对地球表面的图像进行分割,如土地利用分类、建筑物提取等,广泛应用于环境监测和城市规划。

自动驾驶

U-Net还可以用于自动驾驶领域中的车道线检测、障碍物识别等任务,通过精确的像素级分割,提升自动驾驶系统的性能。

7. 总结

U-Net通过其对称的结构和跳跃连接,有效地解决了图像分割中的精度和效率问题,尤其在数据较少的情况下表现尤为优秀。无论是医学图像分割、遥感图像分割还是自动驾驶,U-Net都展现出了强大的分割能力。

通过本文的分析和实现,我们不仅了解了U-Net的原理和结构,还通过代码展示了其实现过程。希望能帮助读者更好地理解U-Net,并能够在自己的项目中应用这一强大的网络模型。

评论记录:

回复评论: